5 Minuty

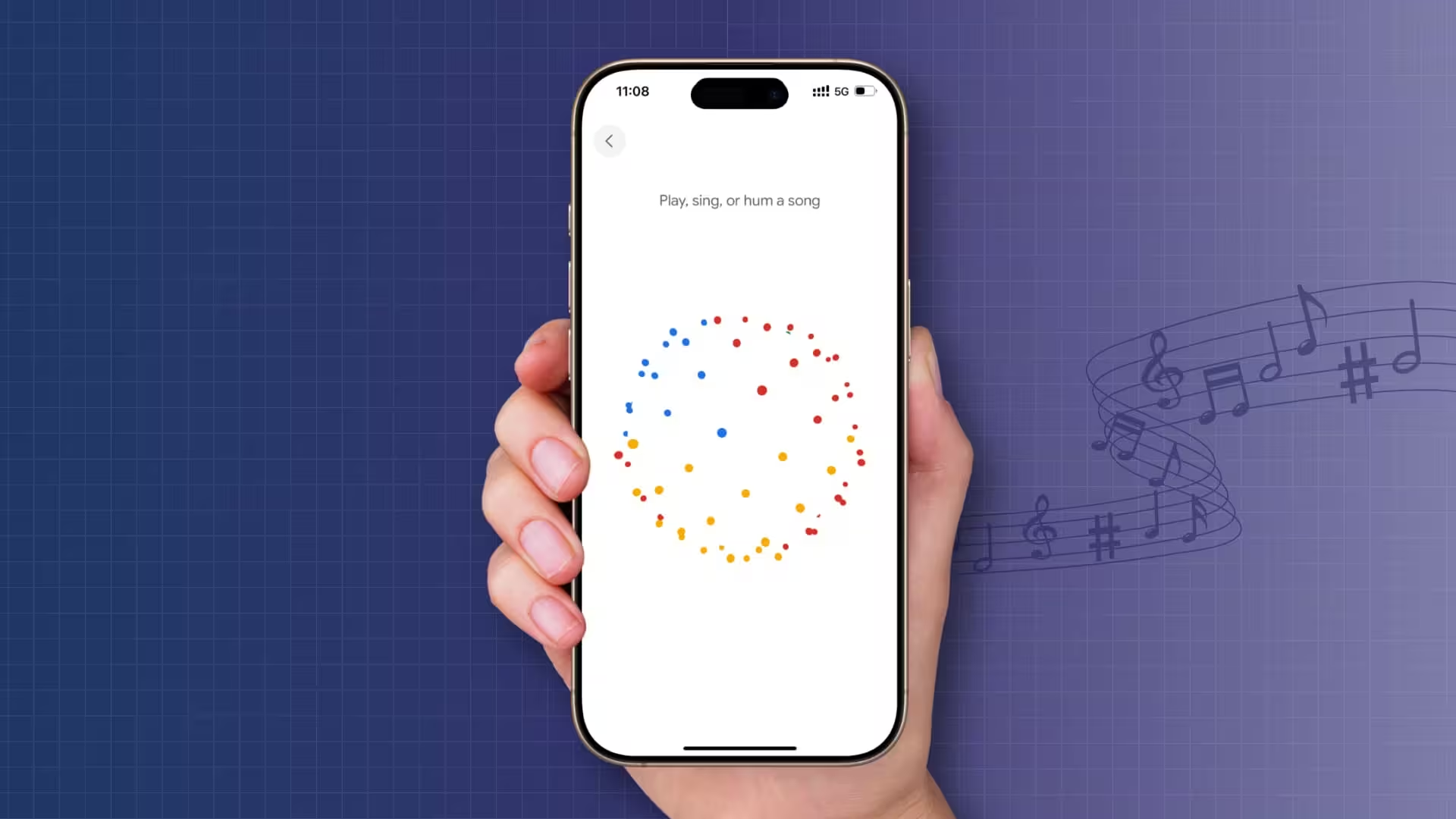

Masz melodię „zakleszczoną” w głowie, ale nie pamiętasz tytułu ani słów? Dzięki nowej funkcji wyszukiwania muzyki można po prostu zanucić fragment, zapukać palcami, a system rozpozna utwór — bez perfekcyjnego tonu czy znajomości wykonawcy. To rozwiązanie łączy praktyczność z zaawansowaną nauką maszynową, upraszczając odnajdywanie piosenek na urządzeniach mobilnych.

Jak szybko znaleźć piosenkę — instrukcja krok po kroku

Aby skorzystać z funkcji wystarczy: otworzyć aplikację Google na smartfonie lub użyć widżetu wyszukiwania, stuknąć ikonę mikrofonu i wypowiedzieć „what's this song?” albo nacisnąć przycisk „Szukaj piosenki”. Następnie nucimy, gwizdamy lub śpiewamy melodię przez 10–15 sekund. W Google Asystencie analogiczna komenda „Hey Google, what’s this song?” rozpoczyna ten sam proces. Funkcja jest obecnie dostępna na Androidzie w ponad 20 językach oraz w angielskiej wersji na iOS, a planowane są kolejne rozszerzenia językowe.

Technologia stojąca za rozpoznawaniem melodii

W praktyce każdy utwór ma unikalny „odcisk” melodii — sekwencję nut i interwałów, które można opisać liczbami. Systemy rozpoznawania transformują nagranie (nucenie, gwizd czy profesjonalne wykonanie) w cyfrową reprezentację tej sekwencji, usuwając jednocześnie zbędne parametry, takie jak barwa głosu czy instrumentacja. Na tej czystej, liczbowej wersji melodii opierają się modele uczenia maszynowego, porównujące ją w czasie rzeczywistym z katalogiem tysięcy nagrań z całego świata.

Modele są trenowane na różnych źródłach: na nagraniach studyjnych, występach na żywo, a także na przykładach ludzi nucących lub gwizdających — dzięki temu algorytm uczy się rozpoznawać tę samą melodię niezależnie od barwy głosu czy tempa. Innymi słowy, utwór taki jak „Dance Monkey” pozostaje rozpoznawalny, gdy jest śpiewany, gwizdany lub nucany, ponieważ jego melodyczny „odcisk” pozostaje stały.

Naukowe tło i powiązane technologie

Pomysł identyfikacji na podstawie cech melodycznych opiera się na technikach analizy sygnału i sieciach neuronowych. Wczesne wdrożenia tej technologii obejmują funkcję Now Playing na Pixel 2 z 2017 roku, która wykorzystała głębokie sieci neuronowe do niskomocowego rozpoznawania muzyki lokalnie na urządzeniu. W 2018 r. podobne mechanizmy trafiły do funkcji SoundSearch w aplikacji Google, rozszerzając katalog rozpoznawanych utworów. Nowe rozwiązanie idzie o krok dalej — rozpoznaje melodię bez konieczności posiadania oryginalnego nagrania lub tekstu piosenki.

W praktyce stosowane są m.in. transformacje czasowo-częstotliwościowe oraz ekstrakcja cech (np. wysokość dźwięku w funkcji czasu), które następnie zamieniane są na sekwencje wektorów opisujących melodię. Modele porównują te sekwencje z wcześniej obliczonymi „odciskami” w bazie danych, stosując metryki podobieństwa odporne na zniekształcenia i różnice w tempie.

Zastosowania i perspektywy

Funkcjonalność „hum to search” ma oczywiste zastosowanie konsumenckie — ułatwia odkrywanie piosenek usłyszanych w radiu, filmach lub w komentarzach rodziny. Dla branży muzycznej i usług streamingowych to wygodna ścieżka do prezentowania utworów słuchaczom. Z perspektywy naukowej i technologicznej rozwiązanie to pokazuje, jak uczenie maszynowe potrafi wydobyć istotne cechy z zaszumionych danych dźwiękowych.

W przyszłości podobne technologie mogą znaleźć zastosowania w badaniach etnomuzykologicznych (identyfikacja motywów ludowych), w archiwizacji dźwięku oraz w interfejsach głosowych dla osób z niepełnosprawnościami. Rozwój modeli, lepsze bazy danych i rozszerzenie języków zwiększą ich użyteczność globalnie.

Expert Insight

„Transformacja melodii na reprezentację liczbową przypomina tłumaczenie muzyki na język zrozumiały dla komputera — usuwamy cechy powierzchniowe i zostawiamy istotę, czyli sekwencję interwałów” — mówi dr Anna Kowalska, inżynier dźwięku i badaczka uczenia maszynowego. „Kluczem jest odporność modelu na różnice w wykonaniu: tempo, intonację czy szumy tła. Im bardziej zróżnicowane dane treningowe, tym lepsze dopasowanie w realnych warunkach.”

Perspektywy bezpieczeństwa i prywatności

Ważne są też aspekty prywatności: przetwarzanie krótkich fragmentów dźwięku lokalnie na urządzeniu zmniejsza ryzyko przesyłania wrażliwych nagrań do chmury. Firmy rozwijające takie funkcje deklarują minimalizowanie przechowywania danych i anonimizowanie przykładów treningowych, ale użytkownicy powinni zapoznać się z ustawieniami prywatności w aplikacji.

Następnym razem, gdy jakaś melodia utkwi Ci w głowie, możesz po prostu zacząć nucić. Nawet bez słów system znajdzie najbliższe dopasowania i pokaże informacje o utworze, klipy wideo, teksty oraz możliwości odtworzenia w ulubionej usłudze streamingowej — szybko i wygodnie dzięki połączeniu analizy sygnału i zaawansowanego uczenia maszynowego.

Zostaw komentarz