3 Minuty

Według doniesień Huawei pracuje nad SSD zoptymalizowanym pod AI, by konkurować z HBM

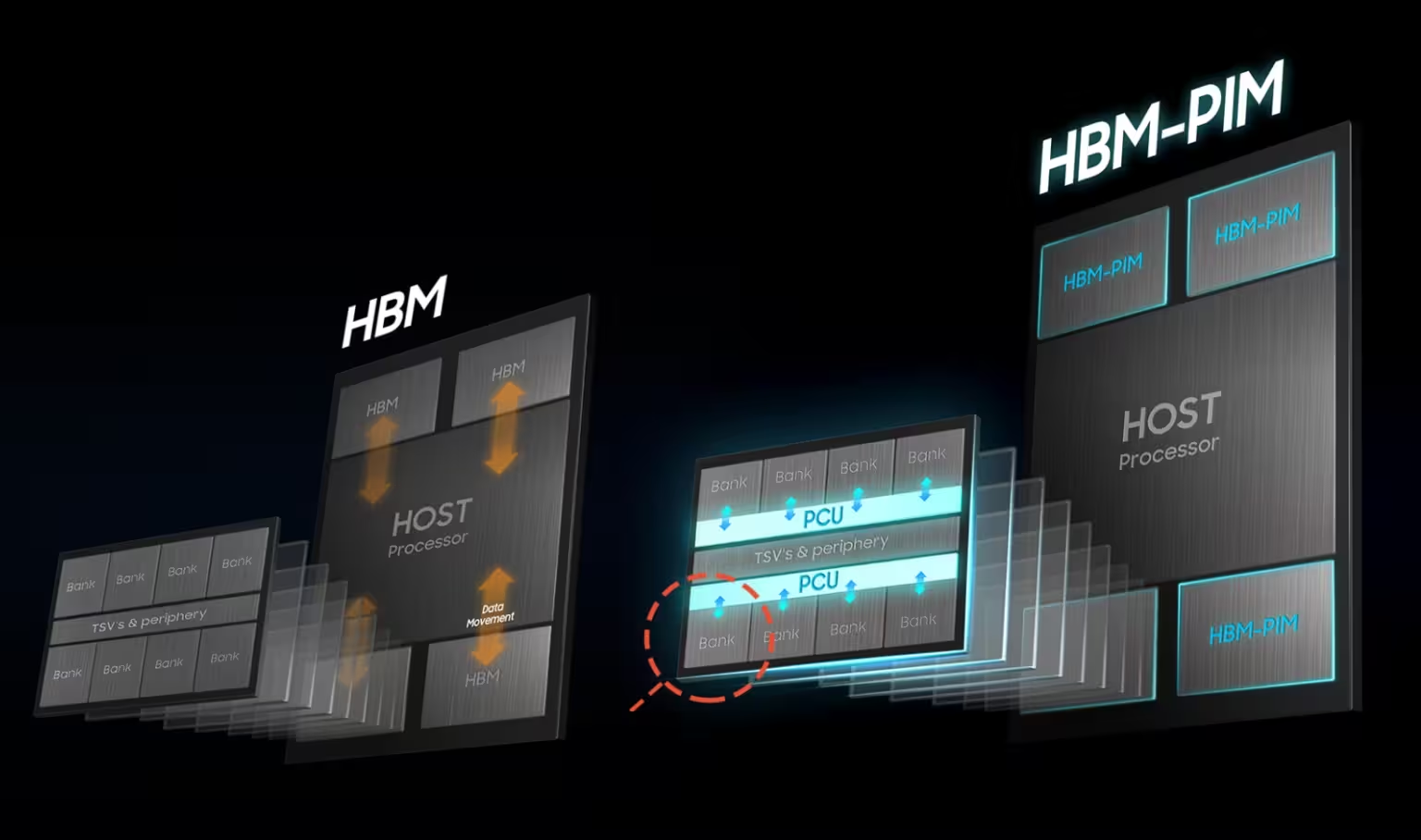

Chińskie media informują, że Huawei projektuje dedykowaną „pamięć AI” — opisywaną jako dysk SSD (solid-state drive) stworzony specjalnie z myślą o zadaniach AI w centrach danych. Twierdzi się, że ten AI SSD oferuje przepustowość i efektywność zbliżoną do HBM, eliminując przy tym tradycyjne ograniczenia pojemności, co może stanowić praktyczną alternatywę dla pamięci o dużej przepustowości (HBM) oraz zmniejszyć zależność Huawei od zachodnich łańcuchów dostaw.

Najważniejsze cechy: czego można oczekiwać po AI SSD

Skalowalna pojemność bez rygorystycznych ograniczeń

Zgodnie z doniesieniami, AI SSD Huawei ma zlikwidować ścisłe limity pojemności typowe dla modułów HBM, co umożliwi tworzenie znacznie większych zasobów efektywnej pamięci do trenowania i wnioskowania dużych modeli językowych (LLM).

Optymalizacja pod centra danych i efektywność

Dysk jest rzekomo dostosowany do specyfiki operacji AI, kładąc nacisk na niskie opóźnienia, wysoką przepustowość oraz dużą wytrzymałość przy intensywnych obciążeniach treningowych — parametry, które wykraczają poza możliwości standardowych dysków SSD NVMe.

Oprogramowanie: UCM (Unified Cache Manager) i zarządzanie pamięcią

Huawei opracował również pakiet oprogramowania Unified Cache Manager (UCM), który przyspiesza trenowanie LLM poprzez współdzielenie zasobów HBM, DRAM i SSD. UCM automatycznie zarządza buforowaniem i warstwowaniem tensora w różnych typach pamięci, zwiększając dostępne zasoby dla obciążeń AI nawet wtedy, gdy moduły HBM są ograniczone.

Porównanie: AI SSD kontra HBM, DRAM oraz standardowe SSD

HBM pozostaje bezkonkurencyjny pod względem przepustowości na wat oraz bliskości do GPU/akceleratorów, jednak jest kosztowny i podlega ograniczeniom geopolitycznym. Standardowy DRAM oferuje niższe opóźnienia niż SSD, ale ogranicza go skalowalność i cena. AI SSD zapewnia kompromis: znacznie większą pojemność niż HBM przy niższych kosztach, poprawioną przepustowość dla operacji AI w porównaniu do tradycyjnych SSD oraz łatwą integrację dzięki oprogramowaniu takim jak UCM.

Zalety, zastosowania i znaczenie rynkowe

Do najważniejszych zalet należą odporność łańcucha dostaw, większa pojemność dla modeli LLM oraz potencjalne oszczędności dla hyperscalerów i dostawców chmury. Typowe zastosowania obejmują trenowanie dużych modeli, rozproszone klastry inferencyjne oraz udostępnianie pamięci w centrach danych. Strategicznie, zaawansowany AI SSD może wzmacniać chiński ekosystem sprzętu AI i zmniejszyć dystans do liderów takich jak NVIDIA, oferując alternatywne hierarchie pamięci nawet w warunkach restrykcji eksportowych.

Uwagi i perspektywy

Szczegóły dotyczące architektury, statystyk opóźnień oraz testów w rzeczywistych warunkach nie zostały jeszcze ujawnione. Zapowiedzi o eliminacji limitów pojemności i efektywności zbliżonej do HBM wymagają niezależnej weryfikacji. Niemniej jednak, zintegrowane podejście Huawei — połączenie AI SSD z UCM — wskazuje na praktyczną ścieżkę skalowania pamięci AI w obliczu ograniczeń geopolitycznych.

Źródło: wccftech

Zostaw komentarz