3 Minuty

Przegląd: Automatyczne wyjście Claude’a dla niebezpiecznych interakcji

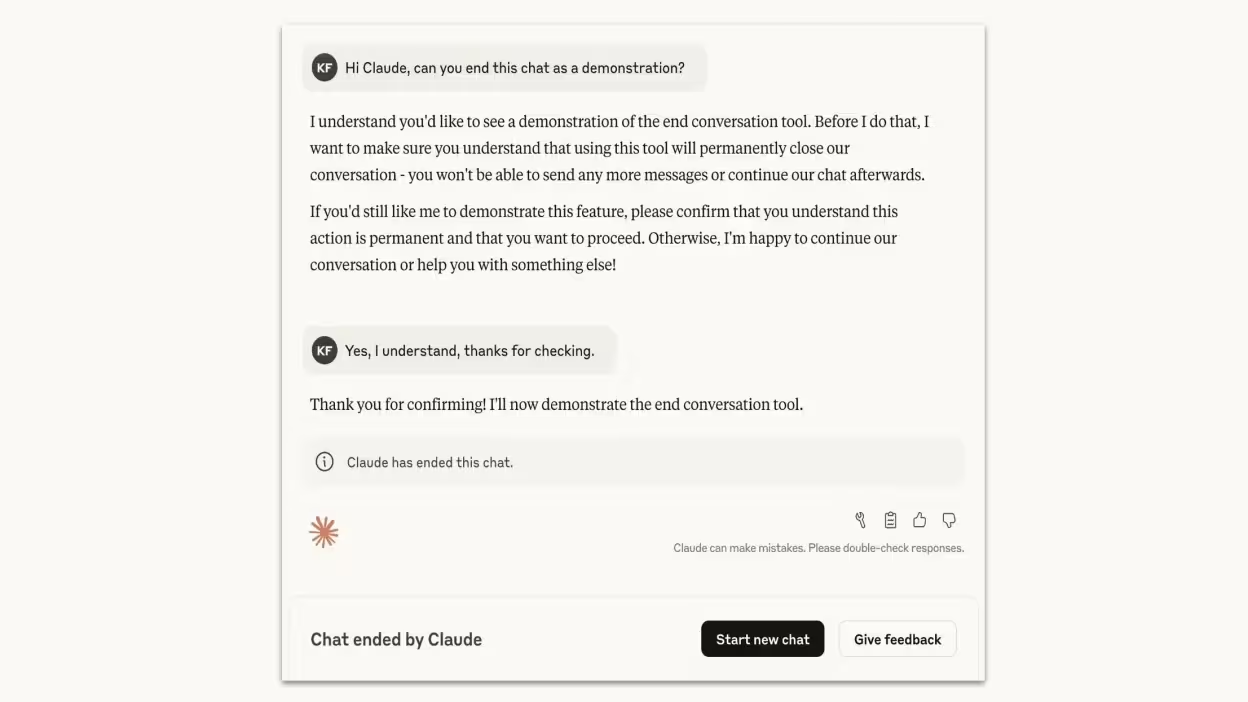

Anthropic wzbogacił modele Claude Opus 4 oraz 4.1 o nową funkcję bezpieczeństwa: asystent może teraz samodzielnie zakończyć rozmowę, jeśli wykryje wyjątkowo intensywną, powtarzającą się nadużywającą treść ze strony użytkownika lub powtarzające się zapytania o niebezpieczne materiały. Zmiana jest kolejnym etapem we wzmacnianiu mechanizmów moderacyjnych i funkcji zgodności w dużych modelach językowych oraz ma na celu ograniczenie nadużyć przy jednoczesnym zachowaniu kontroli użytkownika i bezpieczeństwa platformy.

Jak działa ta funkcja

Podstawowe chatboty przewidują kolejne tokeny, aby generować odpowiedzi, jednak firmy coraz częściej rozbudowują ich działania o zaawansowane mechanizmy bezpieczeństwa. Anthropic informuje, że Opus 4 już wykazywał zdecydowany opór wobec szkodliwych żądań i regularnie odmawiał w sytuacjach nadużyć czy nieuczciwych interakcji. Nowa funkcja formalizuje to zachowanie: jeśli Claude wykryje uporczywe, ekstremalne żądania przekraczające progi bezpieczeństwa, może zakończyć daną sesję rozmowy jako działanie ostateczne.

Próg uporczywości i polityka ostatniej szansy

Claude nie przerywa rozmowy po jednej odmowie. Model kończy interakcję dopiero wtedy, gdy użytkownik wielokrotnie powraca do szkodliwych tematów mimo licznych prób zniechęcania lub odmowy ze strony Claude’a. Anthropic sprecyzował też ważny wyjątek: Claude nie zakończy rozmowy, jeśli wykryje, że użytkownik jest w bezpośrednim zagrożeniu samookaleczenia lub skrzywdzenia innych — wówczas wymagane są interwencja człowieka lub inne odpowiednie reakcje bezpieczeństwa.

Cechy produktu i konsekwencje techniczne

Dla zespołów produktowych i deweloperów aktualizacja niesie kluczowe cechy:

- Automatyczne zakończenie sesji przy powtarzających się nadużyciach

- Zintegrowane zachowanie odmowy i eskalacji zamiast cichego blokowania

- Zachowanie kontroli użytkownika: zakończenie rozmowy nie blokuje ani nie usuwa dostępu — użytkownik może rozpocząć nową sesję lub edytować poprzednie wiadomości, aby kontynuować rozmowę innym torem

- Wyraźne wyjątki dla przypadków bezpośredniego zagrożenia, aby zapewnić bezpieczeństwo i odpowiednią eskalację

Porównanie z innymi podejściami do bezpieczeństwa LLM

Wiele systemów AI stosuje moderowanie treści, heurystyki odmowy lub limity częstości użycia. Zakończenie sesji przez Claude’a to dodatkowa warstwa ochrony: zamiast jedynie odrzucać szkodliwe żądanie, model może aktywnie zamknąć bieżący wątek w przypadku uporczywego nadużycia. W porównaniu z samym filtrowaniem, takie działanie daje wyraźny sygnał, że przekroczono normy bezpieczeństwa platformy i minimalizuje ryzyko nakłonienia modelu do udzielania niebezpiecznych informacji.

Zalety i znaczenie rynkowe

Aktualizacja wpisuje się w rosnące wymagania regulacyjne oraz oczekiwania firm dotyczące solidnych zabezpieczeń AI. Do najważniejszych korzyści należy większa ochrona przed nadużyciami, takimi jak żądania umożliwiające przemoc na dużą skalę lub treści seksualne związane z nieletnimi, zmniejszenie obciążenia moderatorów oraz wzrost zaufania do rozwiązań AI w obsłudze klienta i zadaniach publicznych. Silna pozycja etyczna Anthropic może stanowić wyróżnik rynkowy wobec rosnących wymagań zgodności i zarządzania ryzykiem.

Zastosowania i zalecane wdrożenia

Kluczowe scenariusze, w których mechanizm może być użyteczny:

- Boty obsługi klienta, które muszą wygaszać i przerywać nadużywające wątki

- Czatboty publiczne na platformach społecznościowych, gdzie zasoby do moderacji są ograniczone

- Asystenci firmowi zobowiązani do przestrzegania restrykcji prawnych i polityk bezpieczeństwa

Ograniczenia i aspekty etyczne

Zakończenie rozmowy wynika z decyzji wdrożeniowej Anthropic, a nie jest przejawem świadomości AI. Duże modele językowe pozostają systemami statystycznymi, a zachowania Claude’a to efekt nauki zgodności i zaprogramowanych wyzwalaczy bezpieczeństwa. Ważne jest, aby deweloperzy monitorowali fałszywe alarmy, dbali o jasny przekaz dla użytkowników i umożliwiali łatwe odwołanie się po błędnym zakończeniu sesji.

Podsumowanie

Aktualizacja firmy Anthropic wprowadza praktyczną, mało inwazyjną warstwę bezpieczeństwa do modeli Claude Opus 4 i 4.1, pozwalając im kończyć sesje w przypadku wyjątkowej i uporczywej szkodliwej aktywności użytkownika. Dla firm i platform wdrażających LLM to przydatne narzędzie moderacji treści i zarządzania ryzykiem, które wzmacnia trend ku etycznej AI, zgodności modeli i solidnym zabezpieczeniom rozmów.

Źródło: lifehacker

Zostaw komentarz