5 Minuty

Nowa era pamięci HBM: Przełom Samsunga na rynku AI

Firma Samsung stoi u progu przełomowego momentu w swojej historii. Dosłownie w cieniu fajerwerków obchodów Chińskiego Nowego Roku, koncern może rozpocząć masową produkcję HBM4 – najbardziej zaawansowanej generacji pamięci, która odmieni branżę sztucznej inteligencji.

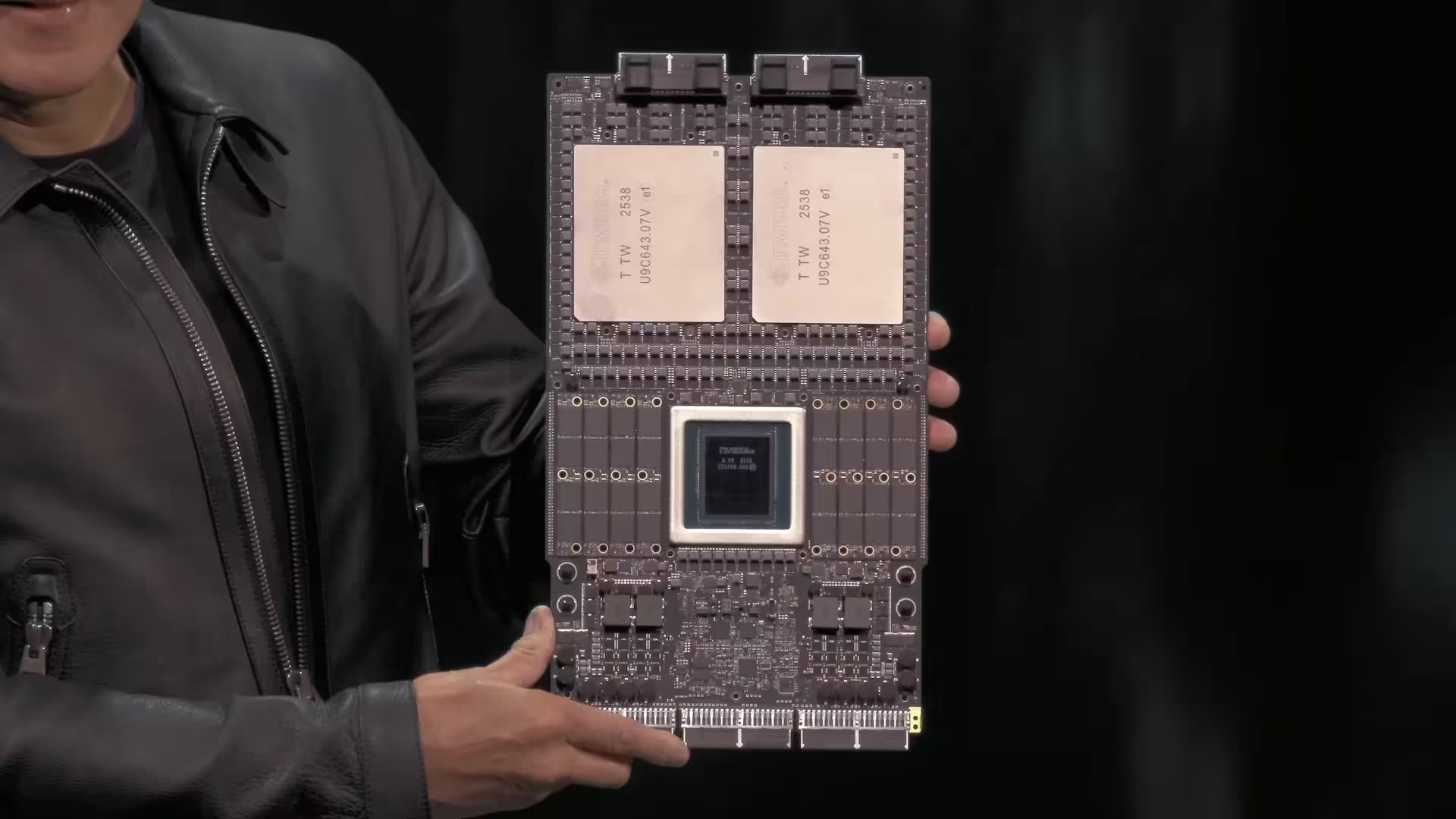

Nowe chipsety pamięci o wysokiej przepustowości HBM4 to nie tylko ewolucja – to technologiczna rewolucja. Stanowią one fundament dla nowej generacji akceleratorów AI, na których opierają się kluczowe architektury, m.in. Nvidia Vera Rubin. To rozwiązania zaprojektowane od podstaw dla generatywnej sztucznej inteligencji na skalę hiperskalową. W raporcie Reutersa czytamy, że dostawy nowych układów do Nvidii mogą się rozpocząć już w najbliższym tygodniu.

Znaczenie przełomu w pamięciach HBM dla rozwoju AI

Dlaczego to wydarzenie jest tak istotne? W świecie obliczeń związanych ze sztuczną inteligencją pamięć stanowi najczęściej główne ograniczenie wydajności. Najszybsza jednostka obliczeniowa pozbawiona równie wydajnej pamięci przypomina auto wyścigowe, które utknęło na pierwszym biegu. Wejście pamięci HBM4 do masowej produkcji przez Samsunga zapewni Nvidii i wszystkim klientom posiadającym te akceleratory AI znaczącą przewagę w zakresie przepustowości i efektywności.

Dotychczas rynek nowoczesnych pamięci HBM3E zdominowany był przez SK Hynix i Micron. Samsung natomiast pozostawał za konkurencją zarówno na polu HBM3, jak i HBM3E. Dynamiczna sytuacja ulega jednak zmianie. Wiarygodne źródła wskazują, że Samsung pomyślnie przeszedł finalne testy weryfikacyjne Nvidii i przyjął pierwsze zamówienia, dopasowując harmonogram produkcji idealnie do potrzeb amerykańskiego giganta. Sfinalizowano kolejne inwestycje, rozbudowano moce produkcyjne. Efekt: Samsung jest na najlepszej drodze, by jako pierwszy dostarczyć HBM4 na szeroką skalę.

Nowa mapa dostawców HBM: Konsekwencje dla infrastruktury AI

Jeżeli Samsung jeszcze w tym miesiącu rozpocznie wysyłkę pamięci HBM4, układ sił wśród dostawców HBM dla infrastruktury AI zostanie na nowo zdefiniowany.

Odbije się to echem nie tylko w przypadku Nvidii. Na dostępność HBM4 z niecierpliwością czekają również Amazon oraz Google. Obie firmy projektują własne, niestandardowe akceleratory do swoich globalnych usług chmurowych. Stabilne dostawy HBM4 mogą bezpośrednio wpłynąć na strategie rozwoju sprzętu, harmonogramy wdrożeń i podejmowane decyzje zakupowe w całym ekosystemie centrów danych korzystających ze sztucznej inteligencji.

Ryzyka rynkowe i szerszy kontekst innowacji na rynku pamięci

Warto pamiętać, że tak dynamiczne zmiany niosą ze sobą pewne zagrożenia. Nieprzewidziane trudności produkcyjne, przestoje w łańcuchach dostaw czy agresywne ruchy konkurencji, na przykład ze strony SK Hynix lub Micron, mogą zmienić przewidywany scenariusz. Niemniej jednak, decyzja Samsunga stanowi wyraźny sygnał: innowacyjność w segmencie pamięci półprzewodnikowych wkracza na jeszcze wyższy poziom. Odpowiedź na rosnące potrzeby generatywnego AI jest coraz szybsza – przekłada się to na skondensowane harmonogramy produkcji, zacieśnianie współpracy z klientami i błyskawiczne wdrażanie nowych generacji pamięci w centrach danych.

Samsung HBM4: Technologiczne detale i przewaga konkurencyjna

- Ultrawysoka przepustowość: HBM4 oferuje znaczący wzrost w stosunku do poprzedników, sięgając kilku terabajtów na sekundę, co realnie skraca czasy dostępu i umożliwia trenowanie ogromnych modeli AI.

- Obniżone opóźnienia: Skrócenie latencji oznacza efektywniejsze przetwarzanie danych przez jednostki AI oraz redukcję zużycia energii.

- Wyższa skalowalność: Dostosowanie do rosnących potrzeb serwerów chmurowych, platform edge computing i przedsiębiorstw wdrażających modele generatywne na dużą skalę.

Wpływ masowej produkcji HBM4 na branżę IT

Sukces Samsunga w uruchomieniu masowej produkcji HBM4 może wzbudzić efekt domina w całej branży AI oraz high-performance computing. Szybszy dostęp do nowych generacji pamięci skraca czas realizacji zaawansowanych projektów, zwiększa elastyczność wdrożeń i daje przewagę firmom inwestującym w najnowocześniejsze rozwiązania sprzętowe. W rezultacie nawet największe korporacje technologiczne mogą zrewidować swoje plany rozwoju infrastruktury.

Nowe możliwości dla centrów danych i chmury

Pojawienie się HBM4 otwiera przed operatorami centrów danych zupełnie nowe możliwości. Szybsze systemy pamięci odpowiadają na rosnące zapotrzebowanie na moc obliczeniową generowaną przez aplikacje AI, przetwarzanie Big Data czy szkolenie modeli językowych. Dzięki skróceniu czasu oczekiwania na sprzęt, migracje na nowe rozwiązania mogą być realizowane szybciej niż kiedykolwiek wcześniej.

- Zwiększenie wydajności chmury publicznej i prywatnej,

- Efektywniejsza realizacja projektów AI w międzynarodowym sektorze finansowym, opiece zdrowotnej czy przemyśle,

- Redukcja kosztów operacyjnych poprzez lepsze zagospodarowanie infrastruktury pamięciowej.

Wnioski: Samsung, HBM4 i przyszłość AI

Najbliższe tygodnie będą kluczowe dla przyszłości rynku pamięci o wysokiej przepustowości. Gwałtowny postęp technologiczny pozwoli na niemal natychmiastowy przeskok wydajności, przesuwając granice możliwego w dziedzinie przetwarzania sztucznej inteligencji.

Implementacja pamięci HBM4 w architekturach Nvidia, Amazon, Google oraz innych globalnych liderów IT, zwiastuje początek nowej ery w rozwoju AI oraz infrastruktury centrów danych. Kiedyś sprzęt tego typu trafiał do masowej infrastruktury z wielomiesięcznym opóźnieniem – dziś równowaga sił może zmienić się praktycznie z dnia na dzień.

Mając na uwadze szybki rozwój technologii, zarówno klienci korporacyjni, jak i dostawcy usług chmurowych powinni bacznie śledzić kolejne ruchy Samsunga i rynku półprzewodników. Przyszłość należy do tych, którzy najszybciej zaadaptują się do zmieniającej się rzeczywistości sprzętowej ery AI.

Źródło: sammobile

Zostaw komentarz