5 Minuty

Zapytaj chatbota AI o cenę akcji, datę rozprawy sądowej lub nazwisko prezesa firmy, a odpowiedź często pojawi się z pełnym przekonaniem. To właśnie ta pewność wzbudza niepokój. Zdanie może brzmieć perfekcyjnie, ton być stanowczy, a mimo to fakty mogą być błędne.

Nowa analiza niezawodności przeprowadzona przez Legal Guardian Digital, firmę SEO specjalizującą się w obsłudze kancelarii prawnych, przedstawia liczby stojące za problemem, z którym wielu użytkowników już się zetknęło: niektóre popularne chatboty AI halucynują znacznie częściej od innych. Ponieważ około jedna czwarta amerykańskich pracowników regularnie korzysta z narzędzi AI, różnica między pomocnym asystentem a wiarygodnym źródłem dezinformacji jest kluczowa.

Niepokojący aspekt: pewność nie oznacza dokładności

Duże modele językowe nie myślą jak ludzie. Są trenowane do przewidywania prawdopodobnych słów i fraz na podstawie wzorców w ogromnych zbiorach tekstów. Gdy system ma wystarczający kontekst, może udzielać szybkich i użytecznych odpowiedzi. W przeciwnym razie model może stworzyć odpowiedź, która wydaje się prawdopodobna, bo statystycznie słowa do siebie pasują.

O tym właśnie mówi się, gdy mowa o „halucynacjach” chatbota AI. To nie fantazjowanie ani kłamstwo w ludzkim rozumieniu. To generowanie odpowiedzi bez solidnej, faktograficznej podstawy, dlatego imiona, daty, odniesienia prawne, informacje medyczne, dane finansowe i bieżące wiadomości nadal wymagają ludzkiej weryfikacji.

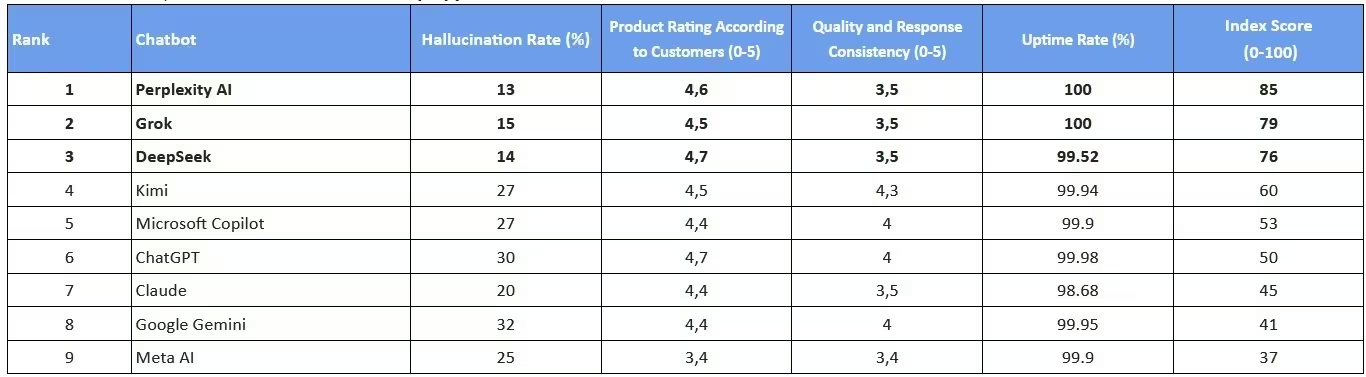

Badanie porównało kilka znanych modeli AI, analizując częstotliwość halucynacji, satysfakcję użytkowników, jakość odpowiedzi oraz dostępność usługi (uptime). Czynniki te połączono w ogólny indeks od 0 do 100, co dało szeroki obraz, które chatboty są najbardziej niezawodne w codziennym użyciu.

Google Gemini uzyskał najwyższy wskaźnik halucynacji w badanej grupie, według raportu dając nieprawidłowe informacje w 32% odpowiedzi. Szczególnie istotne jest to w kontekście doniesień, że Apple płaci Google co najmniej miliard dolarów rocznie za dostęp do spersonalizowanego modelu Gemini z 1,2 biliona parametrów przeznaczonego do przyszłej aktualizacji Siri, planowanej wraz z iOS 27.

ChatGPT uplasował się zaraz za Gemini, z halucynacjami występującymi w około trzech na dziesięć odpowiedzi. Mówiąc prościej – według tych danych, ChatGPT byłby w tym teście około dwa razy bardziej narażony na błędną odpowiedź niż DeepSeek. To porównanie zwraca uwagę, zwłaszcza że DeepSeek powstał przy znacznie niższych kosztach szkolenia niż wiodące modele amerykańskie.

Najlepiej w zakresie ograniczania halucynacji wypadł Perplexity AI – fałszywe odpowiedzi trafiały do użytkowników w 13% przypadków. Zaraz za nim znalazł się DeepSeek z wynikiem 14%, a Grok Elona Muska z 15%. Dla osób korzystających z AI do badań, podsumowań lub szybkich weryfikacji faktów, takie różnice są istotne.

Dostępność online wciąż się liczy

Dokładność to tylko część całości. Chatbot może być genialny w testach, ale bezużyteczny, jeśli nie działa wtedy, gdy jest potrzebny. Pod względem dostępności, Perplexity AI i Grok były jedynymi usługami w badaniu, które były nieprzerwanie dostępne przez cały czas testu.

ChatGPT i Gemini nie pozostawały daleko w tyle – ich dostępność wynosiła odpowiednio 99,98% i 99,95%. Nawet Claude, który uzyskał najniższy wynik w badaniu, pozostał niezawodny z wynikiem 99,68%. W praktyce niemal wszystkie te narzędzia były online praktycznie zawsze, ale nawet drobne różnice mogą być ważne dla firm bazujących na AI.

Opinie użytkowników pokazały kolejny aspekt. DeepSeek i ChatGPT zdobyły najwyższy wynik satysfakcji klienta – 4,7 na 5 możliwych punktów. Perplexity AI osiągnął 4,6. Meta AI zajęła ostatnie miejsce z wynikiem 3,4, a kilka innych modeli oscylowało wokół 4,4.

Pod względem spójności i jakości odpowiedzi liderem był Kimi AI z wynikiem 4,3 na 5. ChatGPT, Microsoft Copilot i Gemini uzyskały po 4,0. Meta AI po raz kolejny znalazła się na końcu stawki z wynikiem 3,4, co sugeruje, że jej niska ocena ogólna wynika z szerokiego zakresu słabości.

Po zsumowaniu wszystkich czynników, Perplexity AI zajął pierwsze miejsce z indeksem 85. Grok był drugi z wynikiem 79, następnie DeepSeek. ChatGPT uplasował się na szóstym miejscu z wynikiem 50, Gemini na ósmym z 41. Meta AI ponownie zajęła ostatnie miejsce z wynikiem 37.

Największa lekcja nie polega na bezgranicznym zaufaniu do jednego chatbota czy trwałym rezygnowaniu z innego. Narzędzia AI szybko się zmieniają – modele są aktualizowane, zasady bezpieczeństwa modyfikowane, a wydajność potrafi rosnąć praktycznie z dnia na dzień. Tego typu ranking przypomina jednak o jednym – najbardziej znany chatbot to nie zawsze ten najbardziej niezawodny, a płynna odpowiedź nie zawsze musi być prawidłowa.

Każdy, kto korzysta z AI w pracy, powinien stosować prostą zasadę: traktuj chatboty jako narzędzia przyspieszające pracę, a nie ostateczne autorytety. Pozwól im szkicować, organizować, podsumowywać i generować pomysły. Ale gdy odpowiedź dotyczy finansów, zdrowia, prawa, tożsamości lub poważnych decyzji, zawsze weryfikuj fakty przed podjęciem działania.

Zostaw komentarz