6 Minuty

Wstęp: Spór wokół wewnętrznych polityk w OpenAI

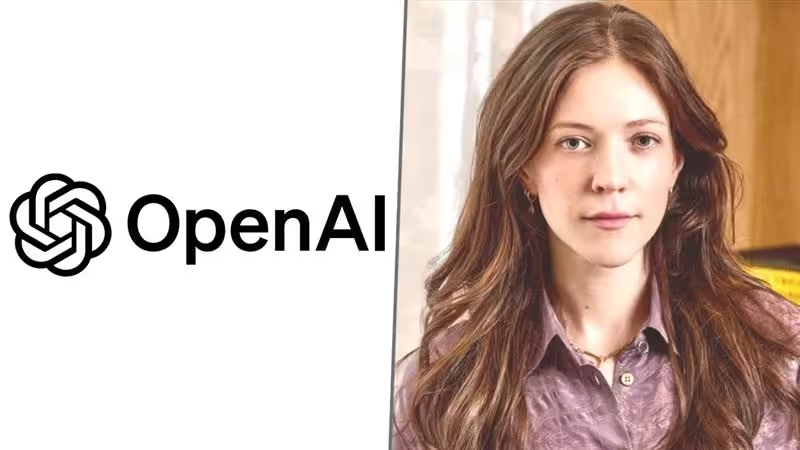

Kto podejmuje ostateczną decyzję, gdy polityka wewnętrzna firmy koliduje z ambicjami rozwoju produktu? To pytanie stało się głośnym tematem w świecie technologii po nagłym odejściu Ryana Beiermeistera – wiceprezesa do spraw polityki produktowej w OpenAI.

Zdarzenie to odbiło się szerokim echem w mediach i branży, szczególnie że miało miejsce w szczególnym momencie – tuż po pojawieniu się kontrowersyjnych zapowiedzi dotyczących rozwoju funkcji „trybu dla dorosłych” w ChatGPT.

Tło sprawy: Okoliczności odejścia Ryana Beiermeistera

Zgodnie z informacjami ujawnionymi przez Wall Street Journal, Beiermeister został zwolniony w styczniu, po oskarżeniu go przez współpracownika – mężczyznę – o dyskryminację ze względu na płeć. Sam zainteresowany stanowczo odrzuca zarzut: „To oskarżenie, jakobym kogokolwiek dyskryminował, jest po prostu fałszywe”, przekazał dziennikarzom w krótkim oświadczeniu.

Moment zwolnienia Beiermeistera wzbudził liczne podejrzenia, ponieważ nastąpiło to w czasie otwartej debaty na temat wprowadzenia nowej funkcji ChatGPT – tzw. „trybu dla dorosłych”, która miała umożliwić bardziej swobodne korzystanie z chatbota. Fidji Simo, szefowa działu aplikacji konsumenckich w OpenAI, potwierdziła wtedy, że funkcjonalność powinna zadebiutować w pierwszym kwartale roku. Harmonogram ten wywołał spore poruszenie zarówno wśród pracowników, jak i poza organizacją.

Kwestie bezpieczeństwa i etyki: Dylematy wokół „trybu dla dorosłych” w ChatGPT

Beiermeister oraz inni członkowie zespołu wyrażali poważne wątpliwości dotyczące wdrożenia trybu o mniejszej kontroli i większej swobodzie. Ich główną obawą było to, w jaki sposób taka funkcja może wpłynąć na szczególnie wrażliwych użytkowników oraz na integralność systemów zabezpieczeń OpenAI. Dylemat był jasny: z jednej strony pojawia się presja ze strony użytkowników domagających się mniejszej cenzury, z drugiej zaś – ryzyko, że poluzowanie zasad doprowadzi do zagrożenia bezpieczeństwa czy wystawienia osób na negatywny wpływ treści generowanych przez AI. Konflikt ten jest niezwykle aktualny w firmie, której narzędzia mogą kształtować poglądy i doświadczenia milionów ludzi w internecie.

Oficjalne stanowisko OpenAI i ranga wewnątrzfirmowych napięć

OpenAI oficjalnie podkreśliło, że rozstanie z Beiermeisterem nie ma związku z jego poglądami na politykę firmy. Organizacja poinformowała, że przebywał on na urlopie i w trakcie zatrudnienia wniósł znaczący wkład w rozwój firmy. Jednak zbieżność czasowa tych wydarzeń sprawiła, że nie zabrakło spekulacji. Gdy nagłe zmiany personalne zachodzą równocześnie z istotnymi kontrowersjami produktowymi, wiele osób naturalnie zadaje sobie pytanie: co było przyczyną, a co skutkiem?

CV Beiermeistera potwierdza, że był osobą o dużym znaczeniu w strukturach OpenAI. Zgodnie z jego profilem na LinkedIn, przez około cztery lata współtworzył rozwiązania produktowe w Meta, a przez siedem lat był związany z Palantirem – firmami, w których codziennością jest nie tylko innowacja, lecz także radzenie sobie z etycznymi i operacyjnymi zawiłościami. To na pewno wpłynęło na jego ostrożne podejście do wdrażania szeroko otwartego trybu konwersacyjnego.

Rosnąca presja: Regulatorzy, użytkownicy, konkurencja

OpenAI funkcjonuje pod silną presją z kilku stron – nadzorcy wymagają jak najwyższego poziomu bezpieczeństwa sztucznej inteligencji, użytkownicy domagają się większej swobody i kontroli, a kadra zarządzająca ściga się z konkurencją, wprowadzając nowe funkcje na rynek. Te rozbieżne oczekiwania często prowadzą do konfliktów, których przebieg jest nieprzewidywalny. Zmiany personalne stają się publiczne, oficjalne komunikaty są analizowane pod kątem ukrytych znaczeń, a zaufanie – zarówno wewnętrzne, jak i zewnętrzne – zostaje wystawione na próbę.

- Bezpieczeństwo AI: presja ze strony regulatorów na odpowiedzialny rozwój AI

- Potrzeby użytkowników: wyraźna chęć personalizacji i znoszenia ograniczeń

- Tempo innowacji: potrzeba zachowania przewagi konkurencyjnej

Jak znaleźć kompromis?

Kwestia wypracowania równowagi między oczekiwaniami rynku a bezpieczeństwem technologicznym pozostaje punktem zapalnym. Wielu ekspertów podkreśla, jak kluczowe jest tworzenie jasnych polityk oraz angażowanie różnych stron – w tym także ekspertów od etyki i bezpieczeństwa AI – w proces wdrażania kontrowersyjnych zmian.

Znaczenie sporu dla przyszłości rynku AI

Pozostająca w cieniu szczegóły oskarżenia o dyskryminację nie zostały ujawnione poza początkowymi doniesieniami. Jednak konflikt wokół „trybu dla dorosłych” jasno ukazuje fundamentalne wyzwanie – firma staje przed kluczowym pytaniem, gdzie przebiega granica między wolnością a odpowiedzialnością, zwłaszcza w miarę udostępniania konwersacyjnej AI coraz większym grupom odbiorców.

Otwarte pozostaje pytanie, jak OpenAI odpowie na ten dylemat i jakie standardy ustanowi swoim przykładem dla całej branży AI – zarówno pod względem rozwoju produktu, jak i odpowiedzialnej polityki wewnętrznej. Ryzyko reputacyjne oraz etyczne jest nieodłącznym elementem prowadzenia działalności na styku innowacji i realnych wyzwań społecznych.

Otwartość i transparentność: Nauka dla branży technologicznej

Sprawa OpenAI ilustruje, jak ważna jest jawność komunikacji i umiejętność publicznego reagowania na kontrowersje wewnętrzne. Firmy rozwijające sztuczną inteligencję muszą otwarcie analizować konflikty między potrzebami użytkowników a bezpieczeństwem i etyką – i być gotowe do szybkiego wdrażania nie tylko technologicznych usprawnień, ale także skutecznych mechanizmów zarządzania ryzykiem.

W dłuższej perspektywie to właśnie takie sytuacje, jak spór wokół ChatGPT w OpenAI, mogą wyznaczać standardy dla całego sektora AI. W centrum pozostaje zawsze najważniejsze: bezpieczeństwo użytkowników, odpowiedzialność twórców oraz zaufanie społeczne do wdrażanych rozwiązań.

Główne wnioski dla branży AI

- Konieczność ścisłej współpracy między działami produktowymi a zespołami odpowiedzialnymi za politykę etyczną

- Budowa przejrzystych mechanizmów podejmowania decyzji dotyczących wrażliwych zmian produktowych

- Dbałość o komunikację i utrzymanie zaufania ze strony użytkowników oraz opinii publicznej

Podsumowanie: Wpływ precedensu OpenAI na przyszłość AI

Odpowiedzi, jakich udzieli OpenAI w sporze między innowacją produktową a rygorystyczną polityką wewnętrzną, nie tylko ukształtują przyszłość ChatGPT, lecz także będą miały wpływ na to, jakie normy zapanują w sektorze sztucznej inteligencji na świecie. Ten precedens pokazuje, jak ważne są etyka, transparentność i dialog w rozwoju najbardziej zaawansowanych technologii XXI wieku.

Źródło: smarti

Zostaw komentarz